Alucinaciones en IA: ¿Cuál es más fiable y por qué?

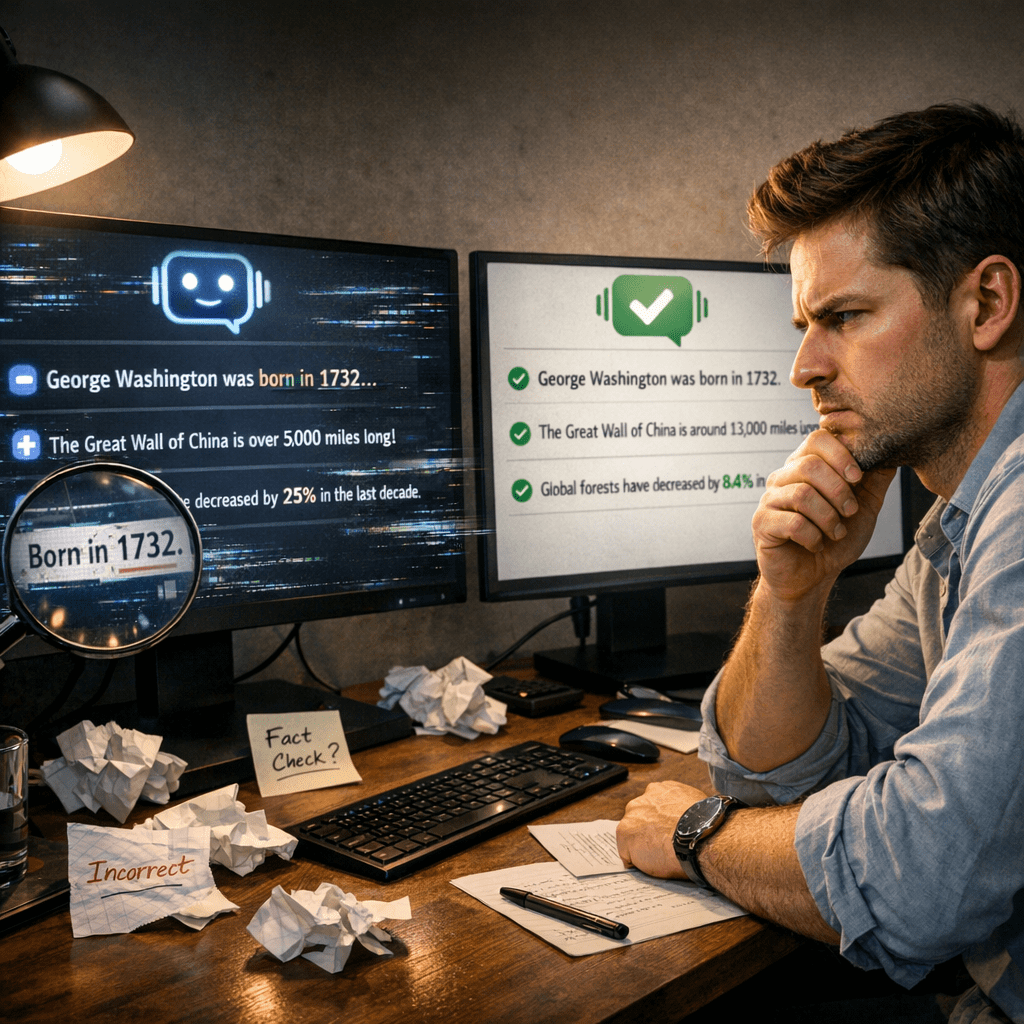

Las alucinaciones en IA representan uno de los mayores desafíos para la inteligencia artificial generativa, donde los modelos generan información falsa pero convincente, como si fuera real. En un análisis reciente del 1 de marzo de 2026, se destaca que mientras algunos sistemas como ciertos modelos de ChatGPT fallan frecuentemente al proporcionar datos inexactos, otros como Grok de xAI se posicionan como casi infalibles gracias a técnicas avanzadas de verificación (3).

Este fenómeno no es un error casual, sino una consecuencia inherente de cómo funcionan los modelos de lenguaje grandes (LLM). La IA «alucina» cuando interpreta patrones inexistentes en sus datos de entrenamiento, genera predicciones improbables o fabrica referencias bibliográficas falsas con una confianza absoluta que engaña incluso a expertos (1)(2). En el ámbito sanitario, por ejemplo, una alucinación puede sugerir tratamientos ficticios o diagnósticos erróneos, poniendo en riesgo vidas al presentarse con autoridad técnica impecable (1). Similarmente, en el sector jurídico, estas falsedades han causado estragos al inventar jurisprudencia inexistente (11).

¿Por qué ocurren las alucinaciones en IA?

Las causas son múltiples y se derivan del entrenamiento de los modelos. Principalmente, provienen de datos insuficientes o sesgados, que llevan a la IA a confundir ruido con información relevante, o a hacer suposiciones erróneas sin contexto real del mundo (2)(4)(10). Otros factores incluyen la falta de datos actualizados, sesgos inherentes o la incapacidad para manejar prompts complejos, lo que resulta en resúmenes incompletos, falsos positivos en detección de amenazas o imágenes incoherentes como personas con extremidades extra (2).

OpenAI ha reconocido en informes que las alucinaciones surgen porque los modelos priorizan la plausibilidad sobre la veracidad, confundiendo coherencia textual con hechos reales (9)(12). En 2026, esto se agrava en aplicaciones críticas como diagnósticos médicos o finanzas, donde una predicción falsa de fraude o un síntoma inventado puede tener consecuencias graves (10).

La IA que más falla vs. la casi infalible

Según el estudio de Infobae, entre los modelos probados, ChatGPT destaca como el que más alucina al dar datos, con tasas elevadas de información inventada en respuestas factuales (3). Esto se debe a su dependencia de memoria paramétrica sin verificación externa constante. En contraste, Grok de xAI emerge como la opción más fiable, casi infalible, gracias a su integración nativa de Retrieval-Augmented Generation (RAG), que recupera documentos reales antes de generar respuestas, reduciendo errores drásticamente (3)(6).

Otras comparaciones muestran que modelos con grounding en fuentes verificables, como aquellos con trazabilidad de datos y DOI persistentes, minimizan alucinaciones hasta en un 78% en proyectos reales (5)(7). La clave está en técnicas como prompts verificables, entrenamiento con datos curados y controles híbridos humano-IA (7).

Para detección de alucinaciones en IA, se recomiendan siete estrategias prácticas: usar RAG para anclar respuestas en evidencia, comparación automática entre modelos, verificación de referencias con huellas criptográficas y revisión humana aleatoria (5)(7). En contextos corporativos, paneles analíticos y gobernanza mejoran la confianza (5).

FAQ: Preguntas frecuentes sobre alucinaciones en IA

¿Qué es una alucinación en IA?

Es cuando un modelo genera información falsa, inexacta o incoherente, presentándola con total confianza, como referencias bibliográficas inventadas o diagnósticos ficticios (2)(6).

¿Por qué la IA alucina más en temas factuales?

Porque prioriza texto plausible sobre hechos verificados, especialmente con datos de entrenamiento sesgados o desactualizados (9)(10).

¿Cuál es la IA más propensa a alucinaciones?

Modelos como ChatGPT fallan más en datos precisos, mientras que Grok es casi infalible por su uso de RAG (3).

¿Se pueden eliminar las alucinaciones completamente?

No hay solución total, pero técnicas como RAG y verificación reducen hasta un 78% los casos (6)(7).

¿Cómo detectar alucinaciones en IA rápidamente?

Verifica referencias con DOI, busca inconsistencias estadísticas y cruza con fuentes confiables (5)(7).

Puntos destacados

- Las alucinaciones en IA no son bugs, sino rasgos de modelos generativos que confunden plausibilidad con verdad.

- ChatGPT lidera en fallos factuales; Grok destaca por fiabilidad vía RAG y grounding.

- Estrategias como datos curados y verificación híbrida son esenciales para minimizar riesgos en 2026.

- En sanidad y derecho, las alucinaciones amenazan decisiones críticas.

Palabras clave:

- Alucinaciones en IA

- Inteligencia artificial generativa

- Detección de alucinaciones

- RAG en IA

- IA fiable 2026

Fuentes:

1 – La Razón

2 – Kaspersky

3 – Infobae

4 – Cloudflare

5 – Q2B Studio

6 – Consultores IA

7 – KeepCoding

9 – Joaquín Rieta

10 – Google Cloud

11 – La Vanguardia

12 – Infobae OpenAI

Tanto el texto como la imagen de esta publicación han sido generados con la asistencia de Inteligencia Artificial. Al tratarse de una tecnología en desarrollo, el texto podría presentar imprecisiones y la imagen (es única y no tiene derechos de autor) podría tener algún detalle.

(Palabras: 728)